Deepfake – most már a szemünknek sem hihetünk?

A deepfake kifejezés a mélytanulás (deep learning) és a hamis (fake) szavak összevonásából született. Olyan digitális kép- és/vagy hangmanipulálási technológiát jelent, amellyel a valódihoz a megtévesztésig hasonlító multimédiás tartalmakat lehet előállítani – például fotókat vagy videókat.

Ha 1 perced van

Nem hiteles, de meghökkentően hihető

A filmipar, a nézők újra és újra meghökkentése érdekében kameratrükkök, animációk, vizuális effektusok és számítógépes technológia alkalmazásával évtizedek óta, folyamatosan igyekszik eltorzítani a valóságot. Hollywood ugyan rendre feszegeti a lehetséges határait, azonban mégsem a profi filmes szakma áll az interneten található rengeteg hamis videó mögött: ezeket jellemzően inkábba hozzáértő „lelkes amatőr” számítógépes guruk készítik. Az első ilyen jellegű hamisítványok 2017-ben születtek, és kezdetben egy Deep Fake nevű felhasználó tette közzé a Redditen.

Mennyire hihető egy ilyen videó?

A rövid válasz az, hogy nagyon. Ma már olyan fejlett deepfake szoftverek léteznek, amelyekkel meghökkentően hihető videók készíthetők. A módszer akár arra is alkalmas, hogy a beszélő forrásarc szájmozgását áthelyezze a célarcra, mintha ő mondaná el a szöveget.

Ebben a videóban például nem Morgan Freeman színész szerepel, hanem az egészet egy számítógép készítette:

Ha van még 3 perced

Hogyan készül a deepfake videó?

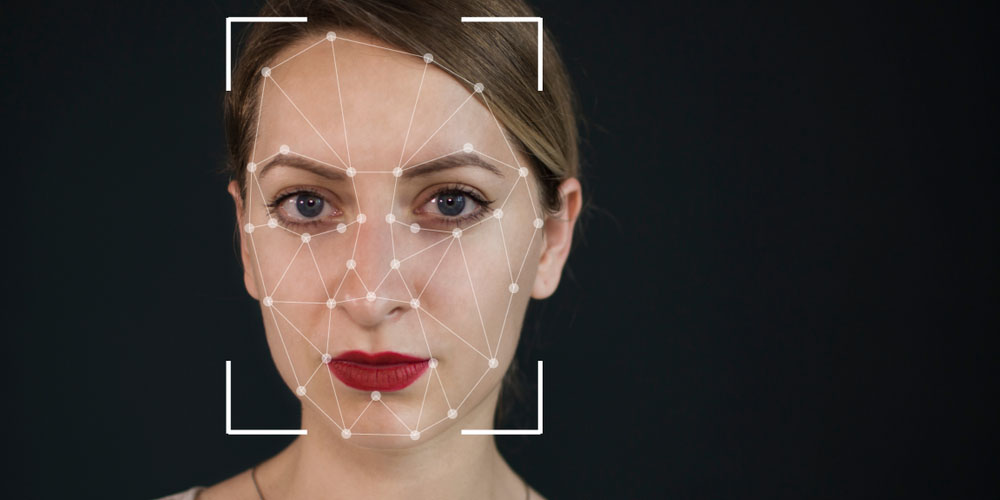

Elsőként fotókat töltünk fel az alanyról a deepfake videót előállító szoftverekbe (ez lesz a forrásarc). A program így megismeri a forrásarc jellemzőit, azok alapján matematikai és informatikai szabályokat hoz létre, majd ennek segítségével újragyártja az úgynevezett célarcot úgy, hogy annak megjelenései és mozdulatai a szintén forrásként feltöltött videóból származnak. Kicsit leegyszerűsítve: rámontírozza a videóban szereplő személy arcára valaki más arcát.

Bárki tud deepfake videókat készíteni?

Egyelőre még nehéz jó minőségű deepfake videókat előállítani, ehhez ugyanis mesterséges intelligenciával és mélytanulással kapcsolatos ismeretekre, valamint videószerkesztési jártasságra van szükség, továbbá egy igencsak nagy teljesítményű számítógépre és az erre a célra alkalmas professzionális szoftverre. Azonban a technológia rohamosan fejlődik, így már nem években, hanem hónapokban, sőt, talán hetekben mérhető a fejlődés. Egyre több mobilapplikáció képes már egyszerűbb (és ezért néha kevésbé hihető) deepfake videókat készíteni. Kínában, 2019 januárjában készítették az első ilyen jellegű alkalmazást, ZAO néven. Gyorsan a legnépszerűbb és legtöbbször letöltött ingyenes alkalmazás lett, több millió felhasználót vonzott. Az arccserélő telefonalkalmazások lehetővé teszik – még a videószerkesztésben képzetlen felhasználó számára is –, hogy saját arcát másolja rá a népszerű TV- és filmfigurákra, hogy minél tökéletesebben beleélhesse magát a szereplő karakterébe. A több millió videóból és videóklipből álló könyvtárak ennek köszönhetően napról napra bővülnek.

Ha van még 5 perced

Hogyan ismerhető fel egy deepfake videó?

Az emberi elme különleges képességekkel rendelkezik és azonnal képes kiszúrni az apró hibákat, amikor valahogyan nincsenek helyén a dolgok (például nem valósághű a mozgás vagy hiányzik a pislogás). Amikor megjelentek a hamisítványok, akkor még könnyű volt leleplezni azokat, mert nem volt elég kifinomult a módszer ahhoz, hogy kiszűrje az emberi agy számára észrevehető, nem természetes hatásokat. Azonban folyamatosan tökéletesítik a technológiát, így egyre nehezebb felismerni a hamisítványokat. Ma már egy fejlett deepfake-szoftver által készített videó szinte megkülönböztethetetlen a valóditól.

Ebben a videóban például láthatjuk, ahogy ismert filmek jeleneteiben a főszereplő arcát kicserélték, az eredmény pedig igencsak meggyőző:

Jelenleg nincs olyan nyilvánosan elérhető eszköz, amely egyértelműen megmondaná egy videóról, hogy deepfake-ről van-e szó, de a fejlesztések ezen a területen is folyamatosak. Ha azonban közzé is tesznek majd egy ilyen alkalmazást, a technológia a program publikálása után is folyamatosan fejlődni fog, így kérdésessé válhat a program hatékonysága. Viszont némi gyakorlással – azaz manipulált videók elemzése révén – fejleszthető a deepfake felismerésének készsége. A Reuters hírügynökség szerint árulkodó jel lehet, ha:

- a kép és a hang nincs tökéletes szinkronban,

- a beszélő szájának mozgása természetellenes,

- a tárgyak vagy emberek szélein szokatlan pixelmintázatok figyelhetők meg,

- a beszélő arca természetellenesen mozdulatlan,

- az alany egyáltalán nem vagy természetellenesen pislog,

- a beszélő szeme tompa.

A deepfake a közösségi médiában terjed, ami a szolgáltatókat is viszonyulásuk megfogalmazására kényszeríti. A Reddit és a Twitter már tiltja oldalain a deepfake videók terjesztését. A nagy technológiai cégek, mint a Facebook és a Microsoft, olyan mesterségesintelligencia-rendszereken (MI) dolgoznak, amelyek azonnal felismerik a deepfake videókat, amint közzéteszik őket. Amint ezek az új MI-rendszerek megjelennek, a videóhamisítók számára egyre nehezebb lesz tartalmat közzétenni az interneten.

Mint minden technológiai újítást, ezt is lehet jó, illetve rossz célokra használni.

A technológia „békés célú” felhasználása

- A multimédiás, elsősorban vizuális anyagok manipulálásának lehetőségeit a tudomány is kutatja.

- Izgalmas eszközei lehetnek a művészi kísérletezésnek.

- Tovább növelheti a filmképi trükkök játékterét.

- Életre keltheti a múlt mozihőseit.

- Megkönnyítheti a régi hangfelvételek javításait.

- A pontosan szimulált hang automatizálhatja a szinkront.

- Fejlesztheti a látássérülteket segítő felolvasóeszközök hangzó képességeit is.

Rosszhiszemű visszaélések

- Akár celebet, akár közembert érint a visszaélés, a hamis videó súlyosan sérti az áldozat méltóságát (például amikor pornográf videók szereplőinek arcát cserélik le valaki máséra).

- Deepfake hanggal hajtottak már végre pénzügyi csalást. (Egy üzletembert külföldi partnere telefonon kérte egy átutalásra. A tranzakció megtörtént, ám utóbb kiderült, hogy a partner hangja számítógéppel generált utánzat volt.)

- Mivel a deepfake szándékosan torzítja a valóságot, felhasználhatják álhírek létrehozására. A módszer alkalmas hamis beszéd előállítására, ezáltal politikai dezinformációt keltve akár pánikot, tömeghisztériát is előidézhetnek vele.

A deepfake korában különösen fontos, hogy kritikai szemlélettel közelíts a médiatartalmakhoz és forrásaikhoz, legyél tisztában az óvatos tényellenőrzés fogásaival!